Datenschutz ist allgegenwärtig, und dennoch bleibt er für die meisten Menschen undurchsichtig. Cookie-Banner, Datenschutzerklärungen und App-Berechtigungen sollen uns informieren, aber in der Realität beantworten sie oft nicht die wichtigste Frage: Was könnte mir tatsächlich passieren?

Diese Herausforderung steht im Zentrum unseres kürzlich erschienenen Artikels „From Procedures to Peril: Towards Risk Transparency in Information Privacy for Users“, der nun in Telecommunications Policy veröffentlicht wurde.

Vom Dagstuhl Seminar zur Veröffentlichung

Die Idee für diesen Artikel entstand im Januar 2025 auf dem Dagstuhl-Seminar „Grand Challenges for Research on Privacy Documents“. Das Seminar, organisiert von Florian Schaub (University of Michigan, USA), Christine Utz (Radboud University Nijmegen, NL) und Shomir Wilson (Pennsylvania State University, USA), brachte eine interdisziplinäre Gruppe von Forschenden aus Bereichen wie Human-Computer Interaction, Recht, Natural Language Processing und Public Policy zusammen, um zu überdenken, wie Datenschutzdokumente in der Gesellschaft funktionieren.

Im Verlauf des Seminars identifizierten die Teilnehmenden ein zentrales Problem: Trotz weit verbreiteter Bedenken hinsichtlich des Datenschutzes fehlt den meisten Nutzerinnen und Nutzern die Zeit, das Fachwissen und die Ressourcen, um Datenschutzdokumente zu verstehen, wodurch sie unzureichend informiert bleiben. Aufbauend auf diesen Diskussionen arbeitete eine internationale Forschungsgruppe im folgenden Jahr weiter zusammen und entwickelte den heute veröffentlichten Perspektivartikel.

Das zentrale Argument: Es geht nicht um Design, sondern um Inhalte

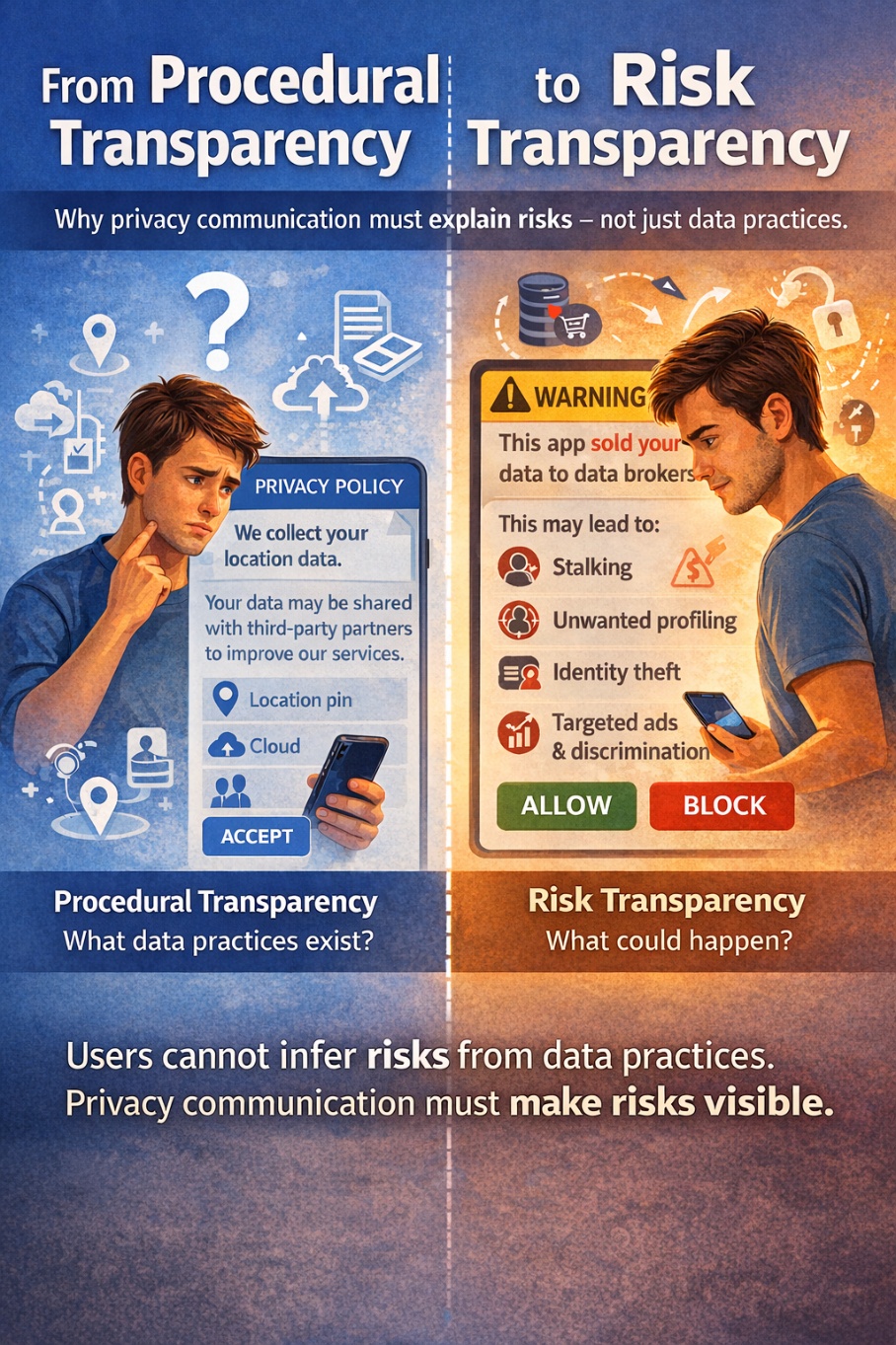

Ein Grossteil der heutigen Datenschutzkommunikation konzentriert sich auf prozedurale Transparenz: Es wird erklärt, welche Daten erhoben werden, wie sie verarbeitet werden und mit wem sie geteilt werden. Diese Informationen sind oft komplex, abstrakt und schwer zu interpretieren. Selbst wenn Nutzer sie verstehen, bleibt eine entscheidende Lücke: Ihnen wird selten gesagt, welchen Risiken sie tatsächlich ausgesetzt sind.

In einer digitalen Umgebung, die zunehmend von KI und datengetriebenen Geschäftsmodellen geprägt ist, wird diese Lücke immer problematischer. Persönliche Daten werden in grossem Massstab gesammelt, analysiert und weitergegeben – was alles von Personalisierung bis Profiling ermöglicht und potenziell zu Schäden wie Diskriminierung, Manipulation oder Sicherheitsrisiken führen kann.

Hin zu Risikotransparenz

Der Artikel plädiert für einen grundlegenden Wandel: weg von der Beschreibung dessen, was mit Daten gemacht wird, hin zur Kommunikation dessen, was passieren könnte. Das Konzept der Risikotransparenz ist in anderen Bereichen bereits etabliert. In der Medizin wird beispielsweise nicht erwartet, dass Patientinnen und Patienten biochemische Mechanismen verstehen; stattdessen werden sie über Nebenwirkungen und Risiken informiert.

Übertragen auf den Datenschutz bedeutet dies, sich von Aussagen wie:

„Diese App sammelt Ihre Standortdaten“

hin zu aussagekräftigeren Formulierungen zu bewegen wie:

„Ihre Standortdaten können mit Dritten geteilt werden und Ihre täglichen Routinen offenlegen, was möglicherweise zu Profiling oder Missbrauch führen kann.“

Forschung zur Risikokommunikation zeigt, dass Menschen bessere Entscheidungen treffen, wenn Risiken konkret und kontextualisiert sind. Erste Erkenntnisse deuten darauf hin, dass dies auch für den Datenschutz gilt: Die Hervorhebung von Risiken kann das Bewusstsein erhöhen und zu einem stärker schützenden Verhalten anregen.